Intel Xeon CPU Max Series — это серверные x86-процессоры, в которых рядом с вычислительными плитками (tiles) размещена высокоскоростная память HBM2e. В практических конфигурациях такой CPU закрывает типовую проблему HPC-узлов: вычислительные блоки простаивают, потому что данные не успевают “подъезжать” из обычной DDR-памяти. В Xeon CPU Max эту роль берёт на себя HBM: она даёт очень высокую пропускную способность и делает поведение памяти более предсказуемым на задачах, где поток данных важнее частоты ядер.

Линейка состоит из трёх моделей: Xeon CPU Max 9480, 9468 и 9462. Все они рассчитаны на двухсокетные серверы (2S), используют DDR5 и PCIe 5.0, а ключевой отличительный элемент одинаковый — 64 ГБ HBM на сокет.

Ниже — разбор архитектурных принципов, режимов памяти и кластеризации (NUMA), затем полный разбор каждой модели с таблицами частотных вариаций и характеристик, и завершение практическим гайдом по выбору и настройке.

1) Позиционирование Xeon CPU Max: “широкая память” вместо гонки частот

У серверных CPU традиционно два пути ускорения:

-

увеличить вычислительную мощность (больше ядер, шире векторные блоки, выше частоты);

-

увеличить скорость подсистемы памяти (больше каналов, выше частота DIMM, более умная иерархия кешей).

На многих HPC-задачах второй пункт даёт более заметный результат, чем попытки “разогнать” вычисления. Классический пример — расчёты, где на один FLOP приходится много обращений к памяти (низкая арифметическая интенсивность). Там процессор ограничен memory bandwidth, а не количеством ALU.

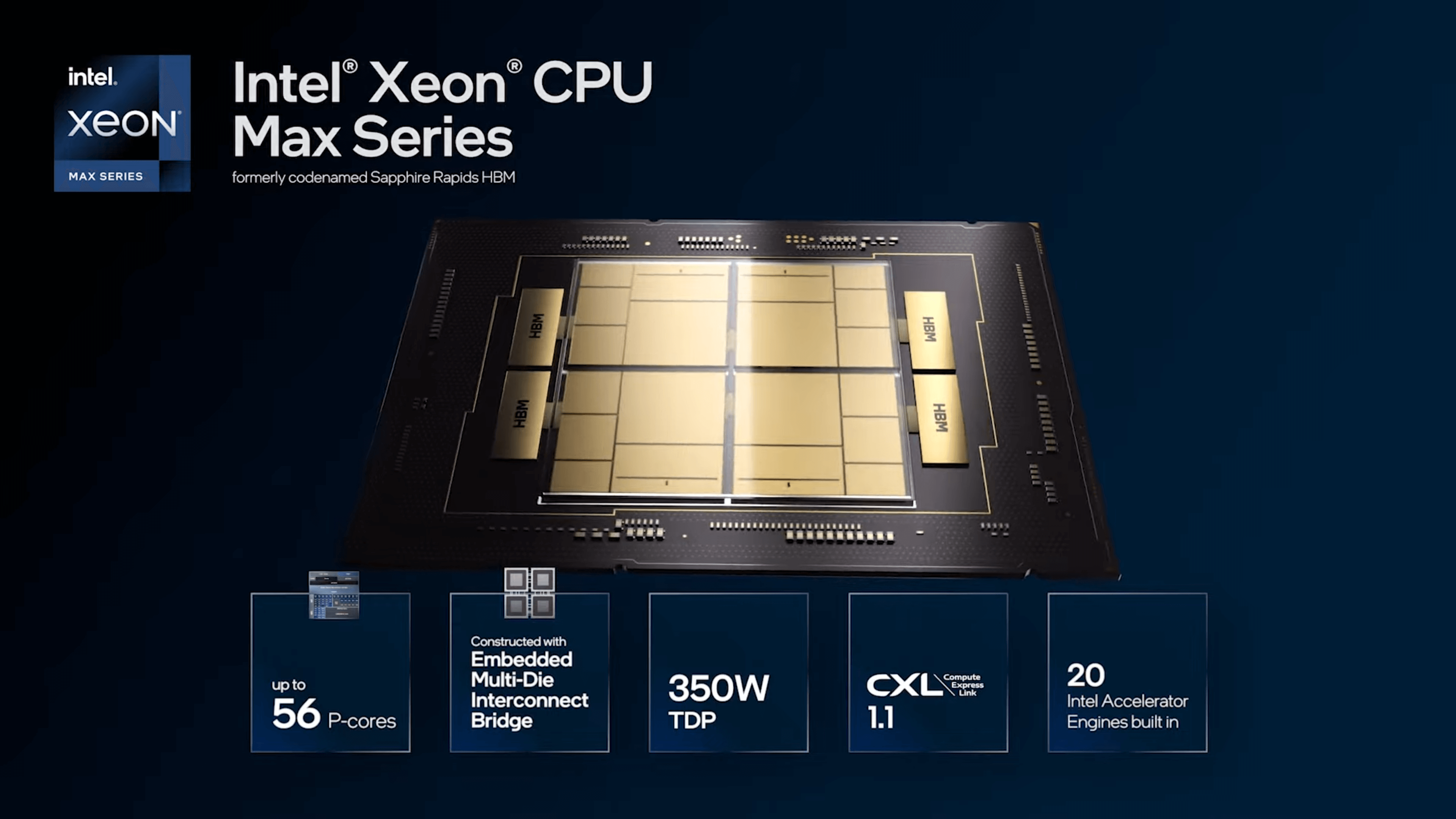

Xeon CPU Max Series создан именно под такой профиль: CPU даёт обычные серверные возможности Xeon, но дополнительно содержит 4 стека HBM2e (в сумме 64 ГБ) на одном процессоре. Это превращает CPU в “память-ориентированный” вычислитель, близкий по философии к ускорителям, только в форме универсального x86-узла.

2) Аппаратная база и ключевые возможности платформы

2.1. Общие параметры линейки

Все модели Xeon CPU Max Series в этой линейке имеют ряд общих свойств:

-

Сокет: FCLGA4677.

-

Масштабирование: 2S (двухсокетные системы).

-

Память DDR5: до DDR5-4800 при 1 DIMM на канал (1DPC) и до DDR5-4400 при 2 DIMM на канал (2DPC).

-

Число каналов памяти: 8 каналов DDR5 на сокет.

-

HBM: 64 ГБ на сокет (4 стека HBM2e по 16 ГБ).

-

PCI Express: PCIe 5.0, до 80 линий на сокет.

-

Теплопакет: 350 Вт у всех трёх моделей.

Эта “общая база” важна для понимания выбора: различия между моделями сосредоточены в числе ядер/потоков, объёме кеша, базовой частоте и деталях межпроцессорной связности (UPI links). При этом HBM как концепция и режимы работы памяти одинаковы для всей линейки.

2.2. Вычислительные и системные технологии

Xeon CPU Max Series сохраняет типичный набор серверных технологий Xeon и добавляет акценты под HPC/AI:

-

AMX (Advanced Matrix Extensions) — матричные инструкции для ускорения тензорных и матричных вычислений на CPU.

-

AVX-512 и набор SIMD-расширений — для линейной алгебры, FFT, физических расчётов и оптимизированных библиотек.

-

DSA (Data Streaming Accelerator) — аппаратное ускорение некоторых потоковых операций перемещения/подготовки данных, которое полезно в I/O-интенсивных и memory-интенсивных сценариях, где требуется разгрузить ядра от сервисной работы.

-

Intel Speed Select Technology – Core Power / Turbo Frequency / Performance Profile — механизм “переупаковки” профиля CPU под задачу, особенно заметный на Xeon CPU Max 9468, где прямо перечислены профили активных ядер и базовой частоты.

-

Серверные функции безопасности и надёжности: ECC, Total Memory Encryption и другие технологии платформенного уровня.

3) HBM2e в Xeon CPU Max: что именно даёт и какие ограничения вводит

3.1. Конструкция: 4 стека HBM2e и ёмкость 64 ГБ на сокет

В Intel Xeon CPU Max Series установлены четыре стека HBM2e, суммарно 64 ГБ HBM на процессор. В двухсокетном сервере это даёт 128 ГБ HBM суммарно.

HBM физически располагается на том же “пакете”, что и процессор, и подключается очень широкой шиной. Это и есть источник высокой пропускной способности: по сравнению с DDR памятью с более узкой шиной и более высокой латентностью на типовых паттернах доступа, HBM обеспечивает более “плотную подачу” данных к вычислительным блокам.

3.2. Что ускоряет HBM в реальности

HBM даёт наиболее заметный прирост на задачах, где выполняются три условия:

-

узкое место — память, а не ALU/векторные блоки;

-

рабочий набор (working set) укладывается в HBM полностью либо в значимой части;

-

у приложения корректно настроены NUMA-привязка и политика размещения данных (особенно в Flat/1LM режиме).

Практические классы нагрузок, где Xeon CPU Max раскрывается:

-

численное моделирование (CFD, FEM), где матрицы/сетки постоянно читаются и обновляются;

-

задачи линейной алгебры и спектральные методы, где важны скорости потоков чтения/записи;

-

MPI-сценарии, где каждый ранг работает с “своим” массивом данных, и правильное закрепление рангов под NUMA-узлы повышает локальность;

-

аналитические пайплайны, которые упираются в память (сканирование больших массивов, трансформации, сортировки с интенсивными обращениями к RAM).

3.3. Ограничения HBM: объём и “стоимость ошибки” в настройке

HBM в Xeon CPU Max — это 64 ГБ на сокет.

Это накладывает дисциплину на архитектуру приложения и конфигурацию узла:

-

ОС и сервисы потребляют память всегда; в режиме HBM-only они конкурируют с приложением за те же 64 ГБ;

-

в Flat/1LM приложению требуется осознанно размещать критичные структуры данных в HBM;

-

в Cache/2LM режиме HBM работает как кеш, и эффективность зависит от повторного использования данных и конфликтов отображения.

Именно поэтому Xeon CPU Max — это “инженерный” CPU: он платит производительностью не частотой, а правильным устройством памяти, и он требует грамотной настройки.

4) Режимы памяти Xeon CPU Max: HBM-only, Flat (1LM), Cache (2LM)

Intel описывает три режима памяти, которые определяют, как HBM и DDR представлены операционной системе и приложениям.

4.1. HBM-only mode

HBM-only выбирается конфигурационно, когда в системе отсутствуют DIMM DDR. В таком режиме единственная доступная память — HBM, то есть 64 ГБ на сокет. ОС и приложения сразу работают с HBM как с основной памятью.

Этот режим даёт максимально “чистый” опыт высокой пропускной способности, но он подходит под задачи:

-

где рабочий набор укладывается в 64 ГБ на сокет;

-

где ОС и служебные процессы не “съедают” критичный объём памяти;

-

где исключены сценарии с тяжёлым paging/swapping.

Intel прямо выделяет практическую рекомендацию для Linux: swapping отключают, потому что своп в HBM-only резко ухудшает производительность.

4.2. Flat mode / 1LM: HBM и DDR как разные NUMA-адресные пространства

Flat (1LM) используется при установленной DDR-памяти. В этом режиме HBM и DDR открываются как отдельные адресные пространства: DDR видна как один NUMA-узел (или набор узлов при кластеризации), HBM видна как другой NUMA-узел (или набор узлов).

Ключевой смысл Flat режима:

-

приложение размещает наиболее “горячие” структуры данных в HBM;

-

менее критичные данные оставляет в DDR;

-

NUMA-привязка процессов и аллокаций становится центральной задачей настройки.

Intel подчёркивает, что для использования HBM в Flat режиме применяются NUMA-инструменты и библиотеки, такие как numactl.

Отдельно важно: просто включить 1LM в BIOS недостаточно для того, чтобы HBM сразу стала частью “дефолтного” пула памяти ОС. Intel описывает, что при загрузке HBM остаётся “скрытой” для ОС, и затем выполняются шаги по её экспонированию в Flat режиме.

На практике это означает: администратор заранее планирует способ, которым приложения будут аллоцировать память в HBM (через NUMA-политику, через специализированные аллокаторы и т. п.).

4.3. Cache mode / 2LM: HBM как прозрачный memory-side cache для DDR

Cache (2LM) также используется при установленной DDR-памяти. В этом режиме для ПО видна только DDR, а HBM работает как прозрачный memory-side cache.

Главные свойства Cache режима:

-

приложения не меняются: оно “думает”, что работает с обычной DDR;

-

ускорение возникает в тех местах, где данные хорошо кешируются в HBM;

-

настройка NUMA и ручное размещение структур упрощаются.

При этом Intel фиксирует важную деталь: HBM в Cache режиме — direct-mapped cache, и для снижения конфликтных промахов (conflict misses) требуются дополнительные конфигурационные шаги.

Это практическая часть инженерии: в некоторых паттернах доступа прямое отображение провоцирует “выталкивание” данных из кеша, и эффективность HBM падает.

5) Кластеризация (partitioning): Quadrant и SNC4 как настройка NUMA-топологии

Помимо режимов памяти, Xeon CPU Max использует режимы кластеризации, которые определяют, на сколько NUMA-частей делится сокет и насколько локальными становятся обращения к памяти и ядрам. Intel описывает два режима: Quadrant и SNC4.

5.1. Quadrant: единое адресное пространство

Quadrant представляет единое адресное пространство (один NUMA-узел) для сокета. В таком режиме приложение не обязано быть NUMA-осознанным, и это удобно для сценариев:

-

большой общий массив данных, который активно разделяют потоки на одном сокете;

-

OpenMP-нагрузки с общими структурами;

-

приложения, где “простота” выше, чем максимальная пропускная способность на поток.

Intel прямо отмечает, что Quadrant подходит для приложений, которые разделяют крупные структуры данных между всеми ядрами сокета.

5.2. SNC4: разбиение сокета на четыре sub-NUMA-кластера (режим по умолчанию)

SNC4 делит каждый сокет на четыре sub-NUMA-кластера, и ПО видит по меньшей мере четыре NUMA-узла на процессор. Intel указывает SNC4 как режим кластеризации по умолчанию, и подчёркивает выигрыш: выше bandwidth и ниже latency внутри партиции по сравнению с Quadrant.

SNC4 рассчитан под HPC-параллелизм:

-

MPI-ранги закрепляются за NUMA-узлами;

-

локальная память (HBM и DDR) используется эффективнее;

-

межузловые/межсокетные переходы минимизируются.

Intel прямо связывает SNC4 с MPI или MPI+OpenMP приложениями и указывает, что SNC4 даёт более высокую пропускную способность и более низкие задержки по сравнению с Quadrant.

6) Двухсокетная конфигурация и связь между CPU

Xeon CPU Max рассчитан на 2S: два процессора в системе связаны Intel UPI. Intel описывает, что в двухсокетной системе процессоры соединяются до четырёх UPI links, и каждый сокет является отдельным адресным пространством NUMA.

Практический вывод:

-

на 2S-узле важно закреплять процессы так, чтобы память и вычисления “жили” на одном сокете;

-

доступ к памяти другого сокета заметно дороже по задержке и слабее по пропускной способности;

-

HBM каждого сокета — локальный ресурс, и на HPC-нагрузке он даёт максимум при локальном использовании.

7) Полный список моделей Xeon CPU Max Series и сводная таблица

Линейка включает три модели:

-

Intel Xeon CPU Max 9480

-

Intel Xeon CPU Max 9468

-

Intel Xeon CPU Max 9462

Сводная таблица характеристик по всей линейке

| Модель | Ядра / потоки | База / Turbo (ГГц) | Кеш (МБ) | HBM (ГБ) | Каналы DDR5 | DDR5 режимы | PCIe | Линии PCIe | UPI links (макс.) | TDP | Масштабирование |

|---|---|---|---|---|---|---|---|---|---|---|---|

| Xeon CPU Max 9480 | 56 / 112 | 1.90 / 3.50 | 112.5 | 64 | 8 | DDR5-4800 1DPC, DDR5-4400 2DPC | 5.0 | 80 | 4 | 350 W | 2S |

| Xeon CPU Max 9468 | 48 / 96 | 2.10 / 3.50 | 105 | 64 | 8 | DDR5-4800 1DPC, DDR5-4400 2DPC | 5.0 | 80 | 4 | 350 W | 2S |

| Xeon CPU Max 9462 | 32 / 64 | 2.70 / 3.50 | 75 | 64 | 8 | DDR5-4800 1DPC, DDR5-4400 2DPC | 5.0 | 80 | 3 | 350 W | 2S |

8) Разбор каждой модели: задачи, частотные вариации и практические сценарии

Далее каждая модель рассматривается отдельно. Внутри раздела — две таблицы:

-

“Паспорт” модели (ядра, кеш, память, I/O);

-

таблица частотных вариаций (то, что реально указано как варианты частот/профилей).

8.1) Intel Xeon CPU Max 9480: максимальное число ядер в линейке и самый большой кеш

Xeon CPU Max 9480 — флагман линейки по количеству ядер. Он ориентирован на плотные HPC-узлы, где важно одновременно:

-

держать высокий параллелизм по потокам;

-

“кормить” эти потоки большой пропускной способностью памяти за счёт HBM;

-

сохранять 2S-масштабирование для наращивания ресурса узла.

Паспорт модели Xeon CPU Max 9480

| Параметр | Значение |

|---|---|

| Ядра / потоки | 56 / 112 |

| Базовая частота | 1.90 ГГц |

| Максимальная Turbo частота | 3.50 ГГц |

| Кеш | 112.5 МБ |

| HBM (макс.) | 64 ГБ |

| DDR5 | до DDR5-4800 1DPC, до DDR5-4400 2DPC |

| Каналы памяти | 8 |

| PCIe | 5.0, до 80 линий |

| UPI links (макс.) | 4 |

| TDP | 350 W |

| Масштабирование | 2S |

Вариации частот (ГГц) для Xeon CPU Max 9480

| Вариант | Что отражает | Значение |

|---|---|---|

| Базовая частота | паспортная базовая частота | 1.90 |

| Max Turbo | паспортная максимальная турбо-частота | 3.50 |

Где 9480 раскрывается

1) MPI-нагрузки с широким параллелизмом.

56 ядер на сокет дают высокий “полезный” параллелизм, а HBM закрывает memory bandwidth для рангов, которые интенсивно читают/пишут данные. На таких задачах решающими становятся NUMA-локальность и режим SNC4, потому что разбиение на sub-NUMA улучшает локальные задержки и пропускную способность внутри партиции.

2) Пакеты линейной алгебры и спектральные методы.

Многие библиотеки оптимизированы под AVX-512, а для матричных вычислений полезен AMX. При этом именно память часто ограничивает масштабирование. В Xeon CPU Max основная идея — подтянуть память до уровня, когда вычислительные блоки реже простаивают.

3) “Плотные” 2S-узлы в кластере.

У 9480 высокий TDP (350 W), и это сразу задаёт требования к охлаждению, питанию и компоновке. В обмен узел получает большой параллелизм и 128 ГБ HBM на систему.

Практические настройки под 9480

-

Выбор режима памяти часто начинается с Cache/2LM для быстрого внедрения: приложения запускаются без изменений, а HBM начинает работать как память-кеш. При дальнейшем тюнинге под конкретные приложения переходят в Flat/1LM и раскладывают критичные структуры по HBM.

-

Кластеризация SNC4 повышает эффективность NUMA-осознанных нагрузок (MPI, MPI+OpenMP) и усиливает локальность.

-

На 2S-узле фиксируют политику закрепления процессов “сокет-локально”: ранги и их память держат на одном сокете.

8.2) Intel Xeon CPU Max 9468: баланс ядер и частот + явные профили SST-PP

Xeon CPU Max 9468 — модель, где Intel прямо показывает профили Intel SST-PP (Performance Profile): варианты активных ядер и базовой частоты при том же TDP. Это делает 9468 удобным выбором под сценарии, где требуются “ступени” производительности без смены CPU.

Паспорт модели Xeon CPU Max 9468

| Параметр | Значение |

|---|---|

| Ядра / потоки | 48 / 96 |

| Базовая частота | 2.10 ГГц |

| Максимальная Turbo частота | 3.50 ГГц |

| Кеш | 105 МБ |

| HBM (макс.) | 64 ГБ |

| DDR5 | до DDR5-4800 1DPC, до DDR5-4400 2DPC |

| Каналы памяти | 8 |

| PCIe | 5.0, до 80 линий |

| UPI links (макс.) | 4 |

| TDP | 350 W |

| Масштабирование | 2S |

Вариации частот (ГГц) для Xeon CPU Max 9468

1) Паспортные частоты

| Вариант | Что отражает | Значение |

|---|---|---|

| Базовая частота | паспортная базовая частота | 2.10 |

| Max Turbo | паспортная максимальная турбо-частота | 3.50 |

2) Intel SST-PP (Performance Profiles): активные ядра и базовая частота

| Профиль | Активные ядра | Базовая частота | TDP |

|---|---|---|---|

| 9468 (0) | 48 | 2.1 ГГц | 350 W |

| 9468 (1) | 40 | 2.2 ГГц | 350 W |

| 9468 (2) | 36 | 2.4 ГГц | 350 W |

Где 9468 выглядит сильнее всего

1) Смешанные HPC-нагрузки, где часть задач чувствительна к частоте, а часть — к bandwidth памяти.

Профили SST-PP позволяют “сдвинуть” баланс в сторону частоты, сокращая активные ядра, но не меняя платформу и не выходя за рамки TDP. Это полезно в средах, где один и тот же узел обслуживает несколько типов задач, и планировщик (scheduler) разворачивает профили под конкретный job.

2) Узлы, где важен компромисс между числом ядер и базовой частотой.

48 ядер на сокет — это всё ещё высокий параллелизм, а базовая частота выше, чем у 9480. При этом HBM и остальные платформенные свойства полностью сохраняются.

3) Внедрение “HBM-узлов” без экстремального перекоса в сторону максимума ядер.

9468 часто выбирают как более сбалансированную точку в линейке: HBM присутствует, PCIe и DDR5 те же, двухсокетность та же, а профиль CPU легче “подстроить” под конкретную задачу.

8.3) Intel Xeon CPU Max 9462: меньше ядер, выше базовая частота, тот же HBM

Xeon CPU Max 9462 — модель, которая берёт тот же фундамент (HBM 64 ГБ, 8 каналов DDR5, PCIe 5.0), но снижает количество ядер до 32 и поднимает базовую частоту.

Паспорт модели Xeon CPU Max 9462

| Параметр | Значение |

|---|---|

| Ядра / потоки | 32 / 64 |

| Базовая частота | 2.70 ГГц |

| Максимальная Turbo частота | 3.50 ГГц |

| Кеш | 75 МБ |

| HBM (макс.) | 64 ГБ |

| DDR5 | до DDR5-4800 1DPC, до DDR5-4400 2DPC |

| Каналы памяти | 8 |

| PCIe | 5.0, до 80 линий |

| UPI links (макс.) | 3 |

| TDP | 350 W |

| Масштабирование | 2S |

Вариации частот (ГГц) для Xeon CPU Max 9462

| Вариант | Что отражает | Значение |

|---|---|---|

| Базовая частота | паспортная базовая частота | 2.70 |

| Max Turbo | паспортная максимальная турбо-частота | 3.50 |

Где 9462 подходит лучше, чем старшие модели

1) Нагрузки, чувствительные к базовой частоте и latency, но при этом упирающиеся в память.

Снижение числа ядер повышает “частотную плотность” на ядро, а HBM закрывает память. Такой профиль полезен для задач с ограниченным параллелизмом, где 56 ядер не дают линейного ускорения.

2) Специализированные узлы под конкретные сервисы/модели расчёта.

В некоторых HPC-пакетах оптимальная точка лежит ближе к 32 ядрам, потому что дальше начинается насыщение по памяти, по межпоточному взаимодействию или по структуре данных.

3) Узлы, где межпроцессорная связность вторична по сравнению с локальными вычислениями на сокете.

У 9462 меньше максимальных UPI links, чем у 9480/9468, и это делает его более “локальным” вариантом в рамках той же платформы.

9) Практика выбора режима памяти: что ставить сразу и что тюнинговать

Ниже — рабочая схема выбора режимов для внедрения Xeon CPU Max в инфраструктуру.

9.1. Cache (2LM) как быстрый старт

Cache/2LM выбирают для быстрого запуска, потому что:

-

ПО видит обычную DDR, без отдельных NUMA-пространств для HBM;

-

HBM начинает работать как прозрачный кеш;

-

требования к переработке приложения отсутствуют.

Intel фиксирует суть Cache режима: видна только DDR, а HBM — transparent memory-side cache.

С инженерной точки зрения у Cache режима есть два “обязательных” пункта контроля:

-

эффективность кеширования на реальном профиле доступа к данным;

-

влияние direct-mapped отображения, которое вызывает conflict misses, и работа по их снижению.

9.2. Flat (1LM) как режим максимального контроля и максимальной отдачи

Flat/1LM выбирают, когда:

-

рабочий набор частично помещается в HBM;

-

приложение или библиотека умеет управлять размещением памяти;

-

NUMA-настройка является частью эксплуатационного стандарта.

Intel описывает Flat режим как два адресных пространства (HBM и DDR), видимых для ПО как разные NUMA-узлы, и указывает необходимость NUMA-осознанных инструментов и библиотек.

Отдельный практический нюанс: Intel описывает, что при загрузке HBM в Flat режиме остаётся “скрытой”, и затем выполняются шаги, чтобы HBM стала доступной для ОС и приложений.

По сути, администратор сразу планирует, каким образом приложения будут аллоцировать память в HBM: через numactl-политику, через специализированные аллокаторы, через NUMA-политику рантайма.

9.3. HBM-only как режим для “компактных” рабочих наборов

HBM-only используют на задачах, которые гарантированно живут в 64 ГБ на сокет и извлекают максимум из bandwidth HBM. Intel подчёркивает, что в HBM-only режиме ОС и приложения делят один и тот же ограниченный объём HBM.

Для такой эксплуатации важны:

-

минимизация фоновых сервисов;

-

отключение swapping;

-

контроль потребления памяти системными компонентами.

10) BIOS/UEFI и базовые настройки Linux под Xeon CPU Max

10.1. Выбор режима памяти в BIOS

Intel описывает конкретный путь меню для выбора режима памяти (на референсной EDKII-прошивке):

-

EDKII Menu → Socket Configuration → Memory Configurations → Memory Map → Volatile Memory Mode → 1LM/2LM

На серверных платформах названия пунктов сохраняют структуру, даже когда формулировки отличаются. Важно именно то, что режим памяти задаётся на уровне BIOS до загрузки ОС.

10.2. Выбор режима кластеризации (Quadrant / SNC)

Intel описывает выбор кластеризации через раздел Uncore и SNC:

-

EDKII → Socket configuration → Uncore configuration → Uncore General Configuration → SNC (Sub Numa)

Эта настройка напрямую меняет NUMA-картину в ОС: Quadrant даёт единый NUMA-узел на сокет, SNC4 делит сокет на четыре sub-NUMA.

10.3. Linux-настройки, которые влияют на отдачу HBM

Intel перечисляет практические опции для Linux, которые применяются ко всем режимам памяти; наиболее важные из них:

-

отключение swapping, особенно в HBM-only режиме;

-

использование zone-reclaim, чтобы снижать NUMA-промахи в сценариях с небольшими NUMA-узлами (например, SNC4), с учётом того, что reclaim добавляет небольшую вариативность.

Для проверки NUMA-картины и объёмов памяти Intel предлагает использовать numactl -H.

Пример команды (для диагностики, без изменения системы):

numactl -H

11) Как подбирать модель и конфигурацию узла: практический алгоритм

11.1. Сначала классифицируют нагрузку

Решение “нужен ли Xeon CPU Max” принимают по профилю:

-

memory-bound: производительность растёт от ускорения памяти и правильной NUMA-локальности;

-

compute-bound: упор в векторные блоки, частоты, эффективность инструкций и компилятора;

-

I/O-bound: упор в сеть, NVMe, файловую систему, параллельность ввода-вывода.

Xeon CPU Max “покупают” под memory-bound и смешанный профили, потому что HBM снимает ограничения по bandwidth, а Flat/Cache режимы дают два сценария эксплуатации: прозрачное ускорение и ручное размещение данных.

11.2. Затем выбирают режим памяти и кластеризации как часть дизайна

-

Для быстрого внедрения выбирают Cache/2LM и SNC4 либо Quadrant в зависимости от NUMA-осознанности приложений.

-

Для максимального результата на конкретном приложении выбирают Flat/1LM и SNC4, фиксируют правила закрепления MPI рангов/потоков и политику аллокации памяти.

-

Для задач с рабочим набором “внутри HBM” выбирают HBM-only, отключают swapping и держат систему максимально “чистой”.

11.3. Выбор конкретной модели: 9480 vs 9468 vs 9462

Xeon CPU Max 9480 выбирают, когда важен максимальный параллелизм на сокет и высокий объём кеша, а также когда задача масштабируется по числу ядер и одновременно упирается в память.

Xeon CPU Max 9468 выбирают как баланс: меньше ядер, выше базовая частота, плюс явные профили SST-PP, которые позволяют менять активные ядра и базовую частоту при том же TDP.

Xeon CPU Max 9462 выбирают, когда параллелизм ограничен, а базовая частота важнее максимального числа ядер, при сохранении HBM и всех платформенных преимуществ.

12) Частые ошибки при внедрении Xeon CPU Max (и как их закрывают на практике)

Ошибка 1: режим Flat/1LM включён, но HBM не используется приложением

Flat режим раскрывается только при управляемом размещении данных. Intel указывает, что HBM и DDR в Flat режиме представлены как разные адресные пространства (NUMA nodes), и для использования HBM применяются NUMA-инструменты и библиотеки.

Практическое исправление: закрепление процессов и памяти через NUMA-политику и аллокаторы.

Ошибка 2: SNC4 включён, но процессы “прыгают” между NUMA-узлами

SNC4 создаёт минимум четыре NUMA-узла на сокет и повышает bandwidth/снижает latency внутри партиции. Это даёт выигрыш, когда приложение NUMA-осознанно.

Практическое исправление: закрепление MPI рангов и потоков на конкретные NUMA-узлы, согласование с планировщиком.

Ошибка 3: Cache/2LM ожидают как “магическое ускорение всего”

Cache/2LM ускоряет то, что хорошо кешируется в HBM. Intel дополнительно фиксирует, что HBM является direct-mapped cache и требует шагов для снижения конфликтных промахов.

Практическое исправление: профилирование, анализ паттернов доступа, корректировка размещения данных и конфигурации.

Ошибка 4: HBM-only используют без контроля памяти и swapping

Intel подчёркивает, что в HBM-only режим единственная память — HBM (64 ГБ на сокет), её делят ОС, фоновые сервисы и приложения. Также Intel рекомендует отключать swapping, потому что он резко деградирует производительность.

Практическое исправление: минимизация фоновой нагрузки, строгий контроль RSS приложений, отключение swapping.

13) Плюсы и минусы Intel Xeon CPU Max Series

Плюсы

-

64 ГБ HBM2e на сокет как встроенный высокоскоростной слой памяти, который даёт заметную отдачу на memory-bound HPC-задачах.

-

Три режима памяти (HBM-only, Flat/1LM, Cache/2LM), которые позволяют выбирать между максимальной управляемостью и прозрачностью для приложений.

-

Два режима кластеризации (Quadrant и SNC4), которые позволяют подстроить NUMA-картину под тип параллелизма.

-

Серверная платформа: DDR5 (8 каналов), PCIe 5.0 (до 80 линий), двухсокетное масштабирование.

-

Наличие AMX/AVX-512 и ускорителей платформы (включая DSA) как инструмента для оптимизированных библиотек и современных AI/HPC-пайплайнов.

Минусы

-

Ограничение по объёму HBM: 64 ГБ на сокет задают требования к рабочему набору и дисциплине размещения данных.

-

Flat/1LM требует NUMA-осознанности приложений и администрирования, иначе HBM остаётся недоиспользованной.

-

Cache/2LM зависит от паттернов доступа к данным и прямого отображения (direct-mapped), что создаёт риск конфликтных промахов без дополнительной настройки.

-

Высокий TDP 350 W у всех моделей усиливает требования к охлаждению и энергетике узлов.

14) Итоги: как воспринимать Xeon CPU Max и какую модель брать

Intel Xeon CPU Max Series — это специализированная ветка серверных Xeon, построенная вокруг идеи “память становится первой сущностью”. HBM2e на сокете меняет экономику HPC-узла: там, где раньше требовалось либо усложнять код ради локальности, либо уходить в ускорители, появляется x86-вариант с очень сильной подсистемой памяти и понятными режимами эксплуатации.

Краткий ориентир по выбору:

-

Xeon CPU Max 9480 — максимальный параллелизм и кеш, сильный вариант для широких MPI-нагрузок и плотных HPC-узлов.

-

Xeon CPU Max 9468 — баланс + явные профили SST-PP, удобен для смешанных нагрузок и эксплуатационной гибкости.

-

Xeon CPU Max 9462 — меньше ядер, выше базовая частота, та же HBM-платформа, сильная точка для задач с ограниченным масштабированием по потокам.

В этой линейке ключ к результату лежит не в “сухом” сравнении частот, а в том, насколько правильно выбраны режим памяти (HBM-only / Flat / Cache), кластеризация (Quadrant / SNC4) и политика NUMA-локальности на уровне приложений и планировщика.