jdupes — это специализированная консольная программа для поиска и обработки дубликатов файлов. Полное расширение названия — Jody’s fdupes: проект вырос из идей fdupes, но давно превратился в самостоятельный, более гибкий и более осторожный инструмент. Главная особенность jdupes в том, что программа работает не с похожими файлами, а только с полностью идентичными копиями. Для администратора, опытного пользователя, владельца большого архива, NAS или просто аккуратно организованной коллекции данных это один из самых точных способов убрать мусор без гаданий и без визуальной магии.

jdupes не пытается угадать, что две фотографии примерно одинаковые, не сравнивает мелодии по тегам, не анализирует визуальное сходство картинок и не ищет документы похожего содержания. Она отвечает на другой вопрос: какие файлы в хранилище совпадают побайтно и что с ними делать дальше. Именно поэтому jdupes особенно хороша там, где важны предсказуемость, автоматизация, сценарная обработка, пакетное удаление и точный контроль над тем, какой экземпляр файла останется основным.

Что такое jdupes и для каких задач ее используют

В реальной работе jdupes чаще всего применяют в тех ситуациях, где накопление одинаковых копий происходит естественным образом: после многократных резервных копий, синхронизаций между SSD и HDD, ручного копирования медиатеки, миграции архивов между компьютерами, объединения нескольких папок с загрузками, хранения фото- и видео-коллекций, а также при наведении порядка на серверах и сетевых хранилищах. Программа умеет не просто показать совпадения, а сразу выполнить действие: удалить лишние копии, заменить их hard links, symlinks или выполнить block-level deduplication/reflink там, где это поддерживается файловой системой.

Это делает jdupes не просто поиском дублей, а инструментом управления дисковым пространством. В одних сценариях она помогает найти одинаковые файлы в нескольких папках и решить, какой из экземпляров оставить. В других — превращает россыпь копий в аккуратную структуру с hard links, где физически на диске данные лежат один раз, а логически доступны по нескольким путям. В третьих — выступает как часть автоматизированного пайплайна: выдает список совпадений, JSON или summary, после чего результаты обрабатываются скриптом, системой резервирования или внутренним регламентом по хранению данных.

jdupes особенно хороша там, где от программы требуется не красивый интерфейс, а жесткая, понятная логика. Она не распыляется на очистку кэша, поиск больших файлов, анализ похожих картинок, удаление пустых папок и десятки смежных задач. Ее специализация уже и оттого сильнее: поиск точных дубликатов файлов с последующим безопасным действием. Именно за счет этой специализации утилита остается очень востребованной у тех, кто работает с большими массивами данных и хочет контролировать процесс до уровня конкретного флага командной строки.

Где jdupes действительно полезна

Самые удачные сценарии для этой программы обычно сводятся к нескольким типовым задачам:

-

очистка папки

Downloads, куда файлы попадают по нескольку раз; -

поиск дублей между основной библиотекой и резервной копией;

-

дедупликация одинаковых файлов на NAS;

-

наведение порядка после ручного слияния архивов;

-

подготовка к переезду данных на новый диск;

-

освобождение места без удаления уникального контента;

-

пакетная обработка дублей в серверных каталогах и рабочих хранилищах.

Что jdupes не делает

Очень важно понимать границу возможностей программы. jdupes не ищет похожие фотографии, не сравнивает аудио по звучанию, не анализирует различия в метаданных как незначимые и не считает два JPEG одинаковыми только потому, что изображение на глаз выглядит одинаково. Если в MP3 изменился ID3-тег, а в JPEG — EXIF-данные, с точки зрения jdupes это уже не один и тот же файл, потому что содержимое файла изменилось. Для задач вроде найти похожие снимки, обнаружить одинаковые песни в разных форматах или сравнить фотографии разного разрешения нужны другие инструменты.

На каких платформах работает программа и как выглядит на практике

jdupes работает на Linux, macOS и Windows, причем для Windows существует нативная сборка, а не случайный неофициальный порт. Ее поведение, ключи и базовая логика едины между платформами, поэтому один и тот же подход к поиску дублей переносится между системами почти без переучивания.

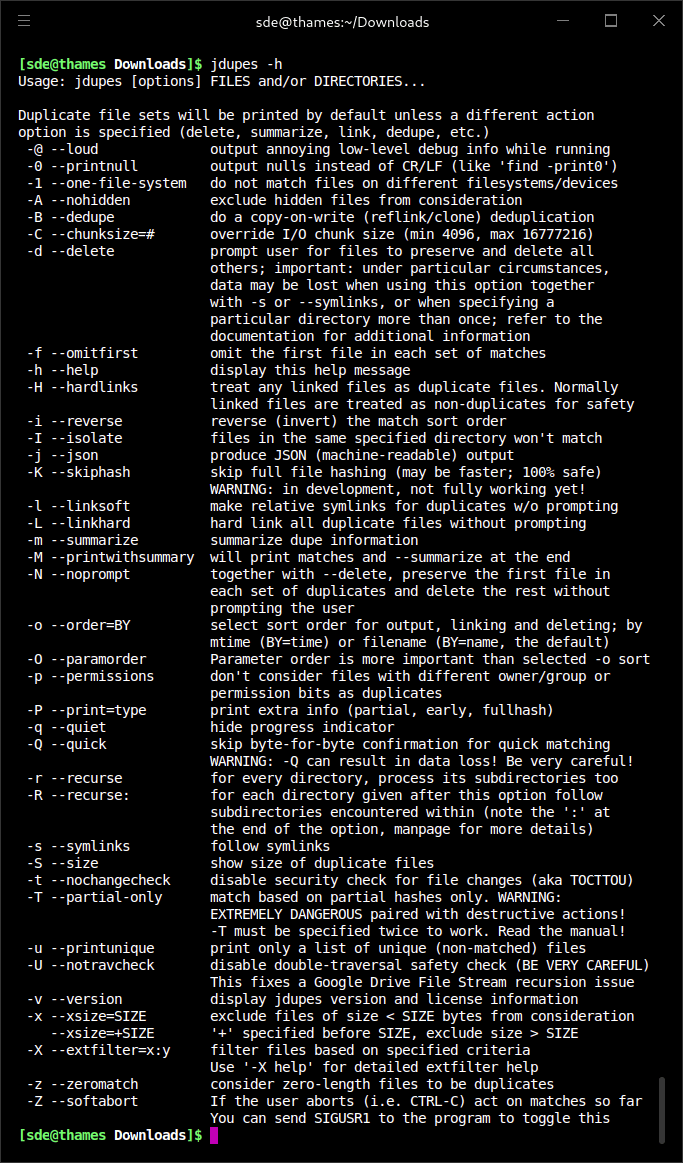

Внешне jdupes — это именно терминальная программа. Ее рабочий интерфейс — командная строка, вывод списков совпадений, приглашения в интерактивном режиме удаления и систематические результаты, пригодные для дальнейшей автоматизации. Здесь нет панели кнопок, дерева каталогов и чекбоксов, как в GUI-утилитах. Зато есть другое преимущество: команды легко повторять, сохранять в скрипты, адаптировать под разные папки и запускать в предсказуемом виде хоть на локальной машине, хоть на сервере, хоть в среде с ограниченным интерфейсом.

На Linux и macOS jdupes естественно вписывается в привычный рабочий процесс терминала: ее запускают по каталогам, комбинируют с shell-скриптами, фильтруют результаты, строят пакетные сценарии. На Windows утилита так же уверенно работает из PowerShell или классической консоли. За счет этого jdupes удобно использовать и в одноразовой ручной очистке, и в повторяемом сценарии обслуживания рабочих папок, архивов и резервных копий.

![]()

Как устроена работа jdupes

Базовый синтаксис программы предельно прямой:

jdupes [options] DIRECTORY...Без дополнительных действий jdupes делает главное: проходит по указанным путям, ищет совпадения и печатает наборы дубликатов. Стандартный формат вывода очень удобен: каждый файл печатается на отдельной строке, а группы совпадений разделяются пустой строкой. Такой формат удобно и глазами читать, и скриптом разбирать, и быстро понимать, где именно у вас лежат одинаковые копии.

С точки зрения внутренней логики программа работает не по имени файла, а по содержимому. Сначала она группирует файлы по размеру, затем использует частичные и полные хэши, а на финальном этапе выполняет побайтовую проверку. Из-за этого jdupes не подменяет строгую идентичность быстрым, но рискованным предположением. Такой подход заметно снижает риск ошибочного совпадения и делает программу особенно полезной там, где потеря данных недопустима.

Именно эта схема объясняет, почему jdupes воспринимается как консольная программа для поиска дубликатов, которой можно доверять в серьезных сценариях. Она не пытается быть умнее пользователя и не скрывает механику за красивыми визуальными абстракциями. Вы ясно понимаете, что ищется, по каким правилам и что именно произойдет после выбора действия. Для опытного пользователя это один из главных плюсов утилиты.

Что означает точный дубликат в jdupes

В контексте jdupes точный дубликат — это не визуально такой же файл, а файл с полностью одинаковым содержимым. На практике это означает следующее:

-

одинаковое имя само по себе ничего не значит;

-

одинаковый размер еще не означает дубль;

-

одинаковый хэш без финальной проверки тоже не считается достаточным основанием в обычном режиме;

-

файл с измененными метаданными уже не будет считаться тем же самым файлом.

Для пользователя это очень важная мысль. Если задача звучит как убрать точные копии и освободить место, jdupes подходит отлично. Если задача звучит как найти почти одинаковые фото, где только разный EXIF, ресайз или другой контейнер, то это уже не про jdupes.

Первый запуск: как найти дубликаты без удаления

Первое знакомство с программой почти всегда должно начинаться без деструктивных действий. Это правильный подход и для новичка, и для опытного пользователя на новых массивах данных.

Поиск в одной папке

Самый простой сценарий:

jdupes /path/to/folderЭта команда проверит файлы в указанной директории без обхода подкаталогов и выведет группы совпадений. Такой режим полезен, когда вы хотите быстро проверить содержимое одного каталога, например рабочей папки, каталога загрузок или набора экспортированных документов. По умолчанию ничего не удаляется и не изменяется: jdupes только показывает результаты.

Рекурсивный поиск по дереву каталогов

Для реальной работы чаще нужен обход подкаталогов:

jdupes -r /path/to/folderКлюч -r включает рекурсию и заставляет программу обработать весь каталог целиком вместе с вложенными папками. Это основной режим для поиска дублей в архиве фото, большом проекте, домашнем хранилище, коллекции документов или медиатеке. Для большинства сценариев именно команда с -r становится отправной точкой.

Смешанный режим с -R

У jdupes есть и более тонкий вариант рекурсии — -R. Он позволяет задать смешанную команду, где одни пути обрабатываются обычным образом, а все каталоги после -R — рекурсивно. Это удобно, когда нужно сравнить, например, один конкретный каталог без углубления и другой каталог полностью, со всем поддеревом. Для сложных сценариев миграции данных и точечной сверки это полезнее, чем кажется на первый взгляд.

Поиск сразу в нескольких папках

Одна из сильных сторон jdupes — возможность искать дубликаты сразу между несколькими путями:

jdupes -r /data/main /data/backup /data/archiveТакой запуск особенно хорош, когда одинаковые файлы разъехались по нескольким дискам, папкам или копиям архива. Программа не ограничивается сравнением внутри одной директории: она сопоставляет файлы между указанными путями, что делает ее полезной при сверке основного хранилища и резервной копии, переносе на новый диск и объединении нескольких наборов данных.

Показ размера дубликатов

Полезное дополнение к базовому выводу — ключ -S:

jdupes -r -S /data/archiveС ним рядом с результатами появляется размер файлов. Это сразу помогает понять, за что имеет смысл браться в первую очередь. Когда в каталоге есть тысячи дублей, обычно разумно сначала смотреть на крупные совпадения: ISO-образы, видеоархивы, базы данных, бэкапы, тяжелые PSD, экспортированные медиаматериалы. Для оценки реальной экономии места -S почти всегда полезен.

Краткая сводка по итогам поиска

Для обзорного анализа удобны ключи -m и -M:

jdupes -r -m /data/archivejdupes -r -M /data/archive-m выводит summary по найденным дублям, а -M совмещает список совпадений с итоговой сводкой. Это удобно в тех случаях, когда нужно не только увидеть конкретные наборы файлов, но и быстро оценить масштаб проблемы: сколько дублей найдено и насколько ощутимый выигрыш по месту можно получить после обработки.

Вывод только уникальных файлов

Менее очевидная, но полезная возможность — -u:

jdupes -r -u /data/archiveЭтот режим печатает только уникальные, не совпавшие файлы. Он хорош не для очистки, а для анализа состава коллекции, проверки неповторяющихся данных перед переносом, резервированием или выборочной синхронизацией. Когда задача состоит не в удалении дублей, а в том, чтобы быстро понять, что именно в архиве существует в единственном экземпляре, -u оказывается очень практичным режимом.

Фильтрация и настройка поиска

Одна из причин, по которой jdupes любят опытные пользователи, — это точная настройка поиска. Утилита не заставляет вас гонять огромные каталоги вслепую. Вы можете ограничить сканирование файловой системой, скрытыми файлами, правами доступа, расширениями, размером и даже текстовыми фрагментами в пути.

Исключение скрытых файлов: -A

Если в каталоге много скрытых служебных данных, кэшей и внутренних папок, включайте:

jdupes -r -A /path/to/folder-A исключает скрытые файлы из рассмотрения. Это особенно полезно на Unix-подобных системах, где в каталогах постоянно встречаются .git, .cache, .config, служебные метки приложений и другой контент, который не стоит смешивать с пользовательскими файлами. Для чистой проверки рабочей коллекции это очень разумная опция.

Ограничение одной файловой системой: -1

Когда нужно, чтобы сравнение не пересекало границы файловых систем или устройств, используется:

jdupes -r -1 /mnt/storage-1 запрещает матчить файлы между разными файловыми системами. Это полезно на серверах, в сложных наборах монтирований и в ситуациях, когда внешний диск, сетевой ресурс или другой том подключен внутрь дерева каталогов и его не нужно смешивать с основной областью сканирования.

Учет владельца, группы и прав: -p

Для более строгого определения дубликата с точки зрения режима доступа подходит -p:

jdupes -r -p /srv/dataС этим ключом jdupes перестает считать дубликатами файлы, у которых отличаются owner/group или permission bits. Для обычного домашнего использования это не всегда нужно, но в многопользовательской системе, на сервере или в каталоге с разграничением прав это помогает не смешивать контент, который содержательно совпадает, но административно относится к разным объектам.

Изоляция указанных каталогов: -I

Один из самых недооцененных ключей — -I:

jdupes -r -I /data/library /data/backup-I делает так, что файлы внутри одного и того же указанного каталога не сравниваются друг с другом. Практически это означает идеальный режим для сценария сравнить только библиотеку и резервную копию между собой, но не искать дубли внутри каждой из них по отдельности. Если вы сверяете два больших дерева данных и хотите видеть только пересечения между ними, -I радикально улучшает удобство работы.

Управление порядком: -o, -O, -i

Порядок результатов в jdupes — не косметика, а важная часть логики, особенно когда вы переходите к автоматическому удалению или линкованию.

Основные варианты:

jdupes -r -o name /datajdupes -r -o time /datajdupes -r -O /data/main /data/backupjdupes -r -i -o time /data-

-o nameсортирует по имени; -

-o timeделает временем модификации ключевой критерий сортировки; -

-Oподнимает приоритет порядка параметров командной строки; -

-iразворачивает порядок сортировки.

Это критически важно в сценариях с -N, -L и другими автоматическими действиями. В jdupes именно порядок помогает управлять тем, какой файл считается первым и остается базовым экземпляром. Например, если сначала передать основную библиотеку, а потом резервную копию и добавить -O, то при автоматическом удалении или hard linking приоритет естественным образом смещается в сторону первой директории. Это один из главных инструментов тонкой настройки поведения программы.

Фильтры -X: расширения, размер, текст в пути, дата

Самый гибкий механизм фильтрации в jdupes — это -X --ext-filter. Он умеет отбирать или исключать файлы по ряду критериев. Список реально полезных фильтров выглядит так:

| Фильтр | Что делает | Пример |

|---|---|---|

noext: |

исключает указанные расширения | -X noext:jpg,png |

onlyext: |

оставляет только указанные расширения | -X onlyext:mp4,mkv |

size+ / size- / size= |

фильтрация по размеру | -X size+:500M |

nostr: |

исключает пути с фрагментом строки | -X nostr:/cache/ |

onlystr: |

оставляет только пути с фрагментом строки | -X onlystr:/Photos/ |

newer: |

включает файлы новее заданной даты | -X newer:2025-01-01 |

older: |

включает файлы старше заданной даты | -X older:2024-01-01 |

Это дает jdupes очень сильную прикладную гибкость. Например, можно искать дубли только среди видеофайлов больше 1 ГБ:

jdupes -r -X onlyext:mp4,mkv,mov -X size+:1G /media/videoМожно исключить служебные каталоги:

jdupes -r -X nostr:/cache/ -X nostr:/tmp/ /dataМожно проверить только PDF и DOCX в рабочем документообороте:

jdupes -r -X onlyext:pdf,docx /work/docsИли выделить старые архивы, которые пора разобрать:

jdupes -r -X older:2023-01-01 /archiveДля программы, которая формально выглядит как просто duplicate finder для Linux, Windows и macOS, это очень высокий уровень контроля.

Нулевые файлы: -z

По умолчанию jdupes не рассматривает нулевые файлы как дубликаты. Чтобы включить их в матчинг, нужен явный флаг:

jdupes -r -z /dataЭто правильное поведение с точки зрения безопасности. Пустые файлы часто бывают служебными маркерами, техническими заглушками или результатом незавершенных процессов. Поэтому jdupes не трогает их автоматически и требует явного согласия пользователя.

Удаление дубликатов: ручной и автоматический режим

Поиск дублей — только половина дела. Настоящая сила jdupes раскрывается в том, как она позволяет с ними работать дальше.

Интерактивное удаление через --delete

Основной режим ручного удаления выглядит так:

jdupes -r -d /path/to/folderПри -d программа не удаляет вслепую. Она выводит набор совпадающих файлов и предлагает выбрать, что сохранить. В интерактивном режиме jdupes нумерует файлы внутри набора и задает вопрос вида keep which files?. Для быстрого выбора доступны варианты вроде [a]ll, [n]one, а в поддерживаемых режимах также команды линкования прямо из этого же интерфейса. После действия jdupes помечает результат по каждому файлу, показывая, что было сохранено, удалено или пропущено из-за изменения состояния файла.

Это очень удобный режим для первой серьезной очистки, когда массив данных уже большой, но автоматическому решению вы пока не готовы доверять. Особенно хорошо он работает на папках пользователя, где названия и структура каталогов сами по себе уже подсказывают, какую копию стоит оставить: файл в основной рабочей папке, файл в папке final, экземпляр с более понятным именем и так далее.

Почему интерактивный режим у jdupes удобнее, чем кажется

На первый взгляд может показаться, что удаление через консольный prompt неудобнее GUI. На практике у jdupes есть другое преимущество: вы работаете не мышкой по списку, а по наборам совпадений, быстро принимая решение по каждой группе. Для больших каталогов такой подход часто быстрее, чем бесконечный интерфейс с колонками, особенно если структура хранилища вам знакома и вы сразу понимаете, какой путь нужен, а какой является мусорной копией.

Автоматическое удаление: -d -N

Когда логика выбора уже понятна и порядок файлов вас устраивает, можно использовать автоматический режим:

jdupes -r -d -N /path/to/folder-N работает только вместе с --delete и означает: сохранить первый файл в каждом наборе и удалить остальные без запроса. Именно поэтому перед таким запуском всегда важно убедиться, какой файл оказывается первым. В jdupes это регулируется через -o, -O, -i и порядок переданных путей. В правильно настроенном сценарии -d -N превращается в очень эффективный инструмент массовой очистки.

Как управлять тем, какой файл останется

Это один из ключевых практических моментов при работе с jdupes. Чтобы оставить приоритет за файлами из основной библиотеки, а копии убрать из резервной, удобно использовать порядок параметров и -O:

jdupes -r -I -O -d -N /data/main /data/backupЛогика здесь такая:

-

/data/mainпередается первым; -

-Oзаставляет порядок параметров иметь решающее значение; -

-Iне дает искать дубли внутри каждого дерева отдельно; -

-d -Nавтоматически удаляет все, кроме первого файла в каждой группе.

Это один из лучших сценариев для поиска дубликатов в бэкапах и последующего аккуратного удаления лишних копий: основной каталог остается эталоном, а резервная копия очищается от повторов, не затрагивая внутреннюю структуру основной библиотеки.

Когда с --delete нужно быть особенно внимательным

У -d есть два действительно опасных контекста, о которых нельзя забывать:

-

использование вместе с

-s --symlinks; -

повторное указание одного и того же каталога в команде.

Если включено следование symlink, пользователь может случайно сохранить символическую ссылку, а удалить файл, на который она указывает. Второй риск еще коварнее: если один и тот же каталог передан дважды, jdupes может увидеть файлы как собственные дубликаты, и при неправильном выборе это уже приведет к потере данных. Именно поэтому программа в целом строится вокруг осторожности, а не агрессии.

Hard link, symlink и dedupe: что умеет jdupes кроме удаления

Очень многие пользователи воспринимают duplicate finder только как инструмент удаления. jdupes умеет куда больше, и в ряде случаев именно эти дополнительные действия ценнее обычного delete.

Hard links: -L

Команда:

jdupes -r -L /data/archiveЗаменяет дубликаты hard links без дополнительного подтверждения. Практический смысл в том, что одинаковые файлы продолжают существовать по своим путям, но физически на диске данные хранятся один раз. Для больших архивов, коллекций документов, зеркальных копий и особенно локальных файловых систем это мощный способ экономии места без изменения логической структуры каталогов.

Hard link — это не ярлык и не shortcut. После такой операции оба пути остаются полноценными именами одного и того же файла на уровне файловой системы. Именно поэтому hard links отлично подходят там, где пользователю важно сохранить привычные пути и имена, но избавиться от фактического дубляжа данных. На Windows при этом существует ограничение на число hard links для одного файла, что тоже стоит учитывать в больших автоматических сценариях.

Sym links: -l

Команда:

jdupes -r -l /data/archiveСоздает для дублей относительные символические ссылки. Это уже другая модель. Symlink визуально похож на файл, но фактически указывает на другой объект. Такой вариант подходит не для всех сценариев, зато может быть полезен там, где hard links нежелательны или невозможны, а сохранить путь нужно именно в виде ссылки.

У symlink есть и обратная сторона: символические ссылки более чувствительны к перемещению каталогов и в целом хуже подходят для тех пользователей, которым нужна максимально прозрачная и незаметная дедупликация. Поэтому на практике для одинаковых файлов чаще выбирают либо hard link, либо обычное удаление, а symlink применяют осознанно, когда его поведение в файловой системе действительно уместно.

Block-level deduplication / reflink: -B

Одна из сильных отличительных возможностей jdupes — -B:

jdupes -r -B /data/archiveЭтот режим делает copy-on-write deduplication, то есть block-level dedupe / reflink. В подходящих файловых системах это позволяет избавиться от лишнего физического дублирования данных без классического hard linking. Для крупных хранилищ, виртуальных образов, больших архивов и систем, где выгодна именно блочная дедупликация, -B делает jdupes особенно интересной на фоне более простых аналогов.

Что выбрать на практике

Если упростить выбор, то логика обычно такая:

| Действие | Когда подходит лучше всего | Что получает пользователь |

|---|---|---|

| Удаление | когда лишние копии реально не нужны | максимальное освобождение места |

| Hard link | когда нужны все пути, но не нужен физический дубль данных | экономия места без изменения логики работы с файлом |

| Symlink | когда допустима ссылка вместо полноценного файла | более гибкая, но менее прозрачная структура |

| Dedupe / reflink | когда файловая система поддерживает эффективную блочную дедупликацию | экономия места с современным copy-on-write подходом |

Именно в этом блоке jdupes выглядит не как очередной сканер дублей, а как действительно зрелый инструмент управления одинаковыми данными.

Дополнительные режимы для продвинутых пользователей

JSON-вывод: -j

Для машинной обработки результатов есть отдельный режим:

jdupes -r -j /data-j превращает jdupes в удобный источник структурированных данных для внешних скриптов, внутренней автоматизации, оркестрации очистки, отчетов и интеграции с другими инструментами. Если обычный текстовый список хорош для человека, то JSON удобен для программного конвейера. Для любой инфраструктурной или полуавтоматической задачи это большой плюс.

Hash database: -y

Еще одна важная возможность для повторяющихся запусков:

jdupes -r -y jdupes_hashdb.txt /dataРежим -y использует текстовую базу хэшей, чтобы ускорять повторные прогоны. Это особенно полезно там, где хранилище большое, а проверки делаются регулярно: например, в рабочем архиве, медиатеке, резервной папке или серверном каталоге, который пересматривается по расписанию. В таких случаях jdupes перестает быть одноразовым инструментом и превращается в часть постоянного обслуживания данных.

-e: ошибка при обнаружении дубля

Полезный служебный режим для автоматизации:

jdupes -r -e /incomingЕсли найдены дубликаты, программа завершится с кодом 255. На практике это удобно в CI/CD, внутренних проверках, серверных пайплайнах, скриптах приемки файлов и регламентах на загрузку данных, где появление дублей должно считаться ошибкой процесса, а не просто фактом для ручного просмотра.

-P: печать дополнительных стадий

Для более детального понимания процесса есть -P --print=type, который показывает дополнительную служебную информацию: частичные проверки, ранние этапы и полные хэши. Это режим не для ежедневной очистки, а для анализа и диагностики, когда нужно понять, как именно программа проходит этапы сравнения.

-q, -D, -@

Эти ключи относятся уже к управлению выводом и диагностике:

-

-qскрывает индикатор прогресса; -

-Dпечатает статистику отладки после завершения; -

-@включает низкоуровневый отладочный вывод.

В обычной пользовательской работе чаще всего действительно нужен только -q, если вы хотите, чтобы лог получился чище и проще для перенаправления в файл или обработки скриптом.

-C: настройка размера I/O-чанка

Ключ -C позволяет вручную изменить размер I/O chunk в KiB. Это уже область тонкой настройки производительности и поведения на конкретном типе хранилища. Для большинства пользователей менять значение не потребуется, но в крупных хранилищах и повторяемых сценариях такой контроль может оказаться полезен.

Опасные параметры и ограничения программы

jdupes очень сильна там, где нужна аккуратность. Но у нее есть и режимы, с которыми надо работать осознанно.

-Q --quick

Ключ -Q пропускает финальную побайтовую проверку. Программа прямо предупреждает, что это может удалить не-дубликаты. На практике -Q нужен только в специальных ситуациях, когда пользователь понимает риск и сознательно меняет надежность на скорость. Для обычной очистки, а тем более для действий вроде delete или linking, использовать его без очень веской причины не стоит.

-T --partial-only

Это еще более опасный режим. Он разрешает матчить файлы только по частичным хэшам и специально требует указать -T дважды, чтобы его нельзя было включить случайно. Если коротко, это экспертский инструмент для очень особых задач, а не режим ускорения в быту. В связке с деструктивными действиями он потенциально крайне рискован.

-t --no-change-check

Этот ключ отключает защитную проверку на изменение файла между сканированием и действием. Такой риск известен как TOCTTOU. В реальной жизни он важен тогда, когда с каталогом одновременно работают другие процессы, сеть, синхронизатор, фоновые сервисы или нестабильная файловая система. Да, -t может помочь в специфических случаях, но нормальный режим jdupes безопаснее именно потому, что проверку не отключает.

-U --no-trav-check

Еще один флаг, который снимает важную защиту: двойную проверку обхода каталогов. В обычных условиях она нужна, чтобы не сопоставить файл с самим собой через ошибку маршрута, повторное указание директории или рекурсивную ловушку через symlink. -U существует для специфических проблемных сред, но как повседневная практика он не нужен.

Таблица рисков

| Опция | Что делает | Главный риск |

|---|---|---|

-Q |

пропускает побайтовую проверку | ложные совпадения |

-T -T |

матчинг только по partial hash | крайне опасные ошибки при удалении или линковании |

-t |

отключает проверку изменения файлов | действие над уже изменившимся файлом |

-U |

отключает защиту двойного обхода | самосовпадения, зацикливание, повреждение результата |

-s вместе с -d |

следует по symlink при удалении | можно сохранить ссылку и удалить ее цель |

Главное достоинство jdupes в том, что опасные режимы здесь не маскируются под ускорение в один клик. Программа прямо разделяет безопасный рабочий режим и экспертские сокращения, которые требуют понимания последствий.

Практические сценарии использования

Сценарий 1. Очистка папки загрузок

Классическая задача — переполненная папка Downloads, где накапливаются повторные PDF, архивы, установщики и образы.

Шаг 1: сначала посмотреть, что вообще есть.

jdupes -r -S ~/DownloadsШаг 2: сузить задачу до тяжелых файлов.

jdupes -r -S -X size+:100M ~/DownloadsШаг 3: ограничить поиск только архивами и образами.

jdupes -r -S -X onlyext:zip,rar,7z,iso ~/DownloadsШаг 4: после просмотра результатов перейти к удалению.

jdupes -r -d ~/DownloadsТакой подход хорош тем, что сначала вы получаете картину, потом отсекаете мелочь, затем разбираете действительно дорогие по месту файлы и только после этого принимаете решение. Это намного разумнее, чем сразу удалять все найденное подряд.

Сценарий 2. Сверка основной библиотеки и резервной копии

Один из лучших сценариев для jdupes выглядит так:

jdupes -r -I -O /data/library /data/backupЭта команда ищет дубликаты между библиотекой и резервной копией, не копаясь во внутренних дублях каждого дерева. Если все выглядит корректно, дальше можно перейти к автоматическому удалению копий из резервной структуры:

jdupes -r -I -O -d -N /data/library /data/backupТакой режим особенно хорош при миграции хранилищ и наведении порядка после многолетних бэкапов, когда задача состоит не в полном удалении дублей отовсюду, а в том, чтобы оставить эталонную библиотеку нетронутой и очистить избыточные копии с другой стороны.

Сценарий 3. Экономия места через hard links

Если дубликаты реально нужны по нескольким путям, но место тратить на них не хочется, лучше не delete, а hard link:

jdupes -r -L /srv/archiveЭто очень хорошо работает на больших наборах документов, исходников, технических сборках, выгрузках и резервных массивах, где один и тот же файл должен фигурировать в нескольких местах. На уровне каталогов ничего не ломается, а реальное потребление места сокращается. Для системного администратора это часто более аккуратное решение, чем удаление с потерей одного из путей.

Сценарий 4. Подготовка большого архива перед переносом на NAS

Перед переносом многолетнего архива на сетевое хранилище удобно сначала снять избыточность:

jdupes -r -M -S /mnt/old_archiveПотом сузить анализ до тяжелых типов:

jdupes -r -X onlyext:mkv,mp4,mov,iso,zip -S /mnt/old_archiveА уже после принятия решений выполнить либо удаление, либо dedupe/hard linking. В таком сценарии jdupes позволяет оптимизировать место на диске без потери данных, еще до того как архив переедет на новую инфраструктуру.

Сценарий 5. Интеграция в скрипт или регламент

Так как jdupes выводит результаты в очень простой текстовой форме, а при необходимости и в JSON, утилиту удобно встраивать в shell-скрипты. Практический пример — проверка входящей папки перед импортом:

jdupes -r -e /incomingЕсли дубликаты найдены, сценарий останавливается. Если нужно подготовить отчет для последующего разбора — лучше использовать -j или -M. В такой роли jdupes работает не как разовая чистилка, а как элемент дисциплины хранения данных.

Производительность и поведение на больших массивах данных

jdupes давно заработала репутацию очень быстрой программы для своей задачи. Ее сильная сторона — не какая-то одна магическая фишка, а совокупность решений: разумная стадийность сравнения, ориентир на безопасность, зрелая логика обхода и хорошая пригодность к повторным запускам. В практическом сравнении с классическим fdupes она заметно быстрее, а на больших массивах данных это уже чувствуется не в процентах, а в сценариях работы.

При этом скорость jdupes не достигается за счет отказа от надежности. Обычный режим сохраняет финальную побайтовую проверку, а значит, не подменяет строгую идентичность достаточно похожим хэш-совпадением. Для больших архивов это важнее, чем агрессивная экономия секунд на одной проверке: чем массив данных больше, тем дороже любая ошибка.

На повторяющихся задачах большую роль начинает играть -y --hash-db=file. Если структура данных меняется не полностью, а частично, jdupes с hash database становится заметно удобнее для регулярного обслуживания больших директорий. Это уже не одноразовый прогон по грязной папке, а полноценный рабочий режим для крупных хранилищ, где одинаковые файлы появляются постепенно.

Важно и то, что jdupes в реальной жизни часто упирается не в CPU, а в ввод-вывод. Поэтому на HDD, сетевых хранилищах, удаленных томах и очень больших коллекциях файлов поведение программы зависит не только от логики сравнения, но и от характера самой файловой системы. Именно поэтому для тяжелых задач jdupes полезно оценивать не только по голой скорости, но и по качеству режимов: фильтры -X, summary, hash DB, аккуратное удаление, hard link, dedupe и хорошая автоматизация вместе дают намного больше, чем просто цифра времени прогона.

Сравнение с аналогами

jdupes и fdupes

Связь между этими программами исторически прямая, но на практике jdupes — уже не просто еще один вариант fdupes. Она быстрее, богаче по действиям и заметно лучше приспособлена к современным сценариям. В jdupes есть dedupe/reflink, JSON, hash database, параметрическое управление тем, какой файл будет сохранен при автоматическом действии, и более развитая логика фильтрации. fdupes остается хорошим классическим инструментом для поиска точных дублей, но в серьезной работе jdupes выглядит более зрелым и более гибким продолжением идеи.

Еще одно важное различие — философия развития. jdupes не пытается сохранять совместимость ради совместимости любой ценой и не держится за устаревшие возможности только потому, что так было раньше. Она явно ориентирована на практическую пользу. Если нужен современный duplicate file finder для Linux, Windows и macOS, который не только показывает дубли, но и умеет гибко с ними работать, jdupes обычно оказывается интереснее классического fdupes.

jdupes и rdfind

rdfind тоже рассчитан на точные совпадения и тоже силен в консольной автоматизации. Он последовательно отсеивает файлы по размеру, затем по началу и концу файла, затем по checksum, после чего может удалять, создавать symlink или hardlink. В этом смысле rdfind близок к jdupes по философии: это не визуальный помощник, а рабочий CLI-инструмент.

Разница в том, что jdupes обычно воспринимается как более универсальный и аккуратно оснащенный вариант для повседневной практики. У нее сильнее проработаны вопросы порядка файлов, фильтрации, интерактивного удаления, JSON и дополнительных режимов вроде dedupe/reflink. rdfind остается хорошим инструментом, но jdupes чаще выигрывает по удобству реального сценария сначала проанализировать, потом аккуратно выбрать действие, затем повторять это по мере необходимости.

jdupes и Czkawka

Здесь сравнение особенно показательное, потому что это уже разные философии продукта. Czkawka — многофункциональный инструмент: она ищет не только дубликаты файлов, но и большие файлы, пустые папки, временные файлы, похожие изображения, похожие видео, дубли музыки по тегам и содержанию, битые файлы, неправильные расширения и другие типы мусора. Для пользователя, который хочет одну программу на все случаи уборки, это очень сильное решение.

Но именно как инструмент для точных дубликатов файлов jdupes часто удобнее, если нужен жесткий контроль и консольный сценарий. Она легче встраивается в автоматизацию, понятнее в серверной среде, лучше подходит для работы по SSH, предсказуемее в пакетных действиях и сильнее там, где требуется именно инженерный workflow: сравнить каталоги, задать приоритеты, удалить или перелинковать дубли по заданному правилу. Czkawka хороша как широкая пользовательская утилита, jdupes — как специализированный рабочий инструмент.

jdupes и dupeGuru

dupeGuru — это почти противоположный полюс по интерфейсной философии. У него есть три режима: Standard, Music и Picture. Он умеет искать похожие картинки, работает с музыкальными тегами, поддерживает понятную GUI-логику выбора каталогов и даже вводит концепцию Reference folders, где одни папки можно объявить эталонными и тем самым защитить их содержимое от удаления. Для пользователя, которому важен визуальный режим и сравнение не совсем одинаковых файлов, dupeGuru часто оказывается комфортнее.

Но если нужен поиск именно побайтно одинаковых файлов, прозрачная консольная автоматизация, работа на больших каталогах, сценарии сервера или NAS и точный контроль над hard links, symlinks и dedupe, jdupes выглядит сильнее и профессиональнее. У dupeGuru выше порог удобства для новичка, у jdupes — выше плотность рабочего контроля и лучшее соответствие инфраструктурным задачам.

Сводное сравнение

| Программа | Тип интерфейса | Ищет только точные дубликаты | Ищет похожие изображения или музыку | Автоматизация и скрипты | Дополнительные действия |

|---|---|---|---|---|---|

| jdupes | CLI | Да | Нет | Отлично | delete, hard link, symlink, dedupe/reflink, JSON, hash DB |

| fdupes | CLI | Да | Нет | Хорошо | базовый поиск и удаление, меньше гибкости |

| rdfind | CLI | Да | Нет | Хорошо | delete, symlink, hardlink, results file |

| Czkawka | GUI/многофункциональный инструмент | Не только это | Да | Хуже для чистого CLI-сценария | много типов очистки кроме дублей |

| dupeGuru | GUI | Есть режим точных совпадений | Да, для картинок и музыки | Ограниченно | удобный ручной разбор, reference folders |

Преимущества и недостатки jdupes

Главные преимущества

У jdupes действительно много сильных сторон, и почти все они практические:

-

строгий поиск только 100% точных дубликатов;

-

аккуратный и предсказуемый подход к безопасности;

-

высокая пригодность для больших массивов данных;

-

гибкое удаление с контролем порядка файлов;

-

возможность заменить дубликаты hard links, symlinks или dedupe/reflink;

-

удобный стандартный вывод для shell-обработки;

-

JSON для машинной интеграции;

-

hash database для повторных запусков;

-

хорошие фильтры по размеру, расширению, дате и строке пути;

-

нативная кроссплатформенность.

На практике это означает, что jdupes легко масштабируется от простой задачи найти одинаковые файлы в папке до полноценного рабочего инструмента для серверов, NAS, многолетних архивов и регулярного обслуживания хранилищ. Утилита одинаково убедительна и в разовой ручной чистке, и в скриптовом сценарии.

Недостатки

Недостатки у программы тоже есть, и они напрямую следуют из ее философии:

-

это консольная утилита, а не дружелюбный GUI для новичка;

-

она не ищет похожие фотографии, музыку и документы;

-

часть действительно полезных сценариев требует понимания

-O,-I,-o,-i; -

опасные режимы вроде

-Q,-T,-t,-Uтребуют дисциплины; -

для ручного визуального разбора большие наборы дублей удобнее смотреть в GUI-инструментах.

Поэтому jdupes — это не программа для всех. Она рассчитана на пользователя, который готов мыслить каталогами, путями, наборами совпадений и правилами действий. Но для такой аудитории это именно преимущество, а не проблема.

Кому подойдет jdupes, а кому лучше выбрать другую программу

Кому jdupes подходит идеально

Эта программа особенно хорошо ложится на задачи следующих пользователей:

-

системные администраторы;

-

power users;

-

владельцы NAS и больших медиатек;

-

пользователи, которые любят терминал и автоматизацию;

-

те, кому нужен поиск одинаковых файлов по содержимому, а не визуальная угадайка;

-

те, кто хочет не просто удалить дубликаты, а еще и применять hard links, symlinks или dedupe.

Кому лучше смотреть на альтернативы

Если вам нужен графический интерфейс, визуальное сравнение, режим похожих фотографий, поиск почти одинаковых песен или просто ощущение более привычной настольной программы, то логичнее смотреть в сторону Czkawka или dupeGuru. Там выше комфорт первого использования и проще ручной разбор сложных пользовательских коллекций, особенно фото и музыки.

А вот если вы хотите именно безопасное удаление дублей, повторяемые команды, логику основная библиотека против бэкапа, хорошую консольную интеграцию и точный контроль над тем, что останется после обработки, jdupes выигрывает очень уверенно.

Итоги

jdupes — это не универсальный комбайн для чистки, а зрелая, очень конкретная и очень полезная программа для одной задачи: поиска и обработки точных дубликатов файлов. И именно благодаря этой специализации она оказывается настолько сильной. Программа не распыляется, не подменяет точность удобной иллюзией и не скрывает от пользователя важные детали. Вместо этого она дает надежный алгоритм сравнения, понятный формат результатов, гибкое удаление, hard linking, symlinking, dedupe/reflink, машинный вывод и аккуратный набор защитных механизмов.

Для домашнего пользователя, который хочет просто что-нибудь почистить мышкой, jdupes может показаться слишком прямолинейной. Для опытного пользователя, администратора, владельца большого архива или любого, кто регулярно сталкивается с дубликатами на серьезных объемах данных, это уже совсем другая история. В своей нише jdupes — один из самых убедительных инструментов: быстрый, строгий, предсказуемый и действительно рабочий.